KI-Anwendunge erobern immer mehr den Markt. Allerdings richtet man den Blick hier sehr oft nur auf die Software. Aber auch im „Untergrund“ tut sich etwas, denn Hersteller wie Nvidia und andere haben in Zusammenarbeit mit den großen Playern neue Konzepte und Technik für Chips entwickelt, die schon auf Servern und auch auf Endgeräten eingesetzt werden.

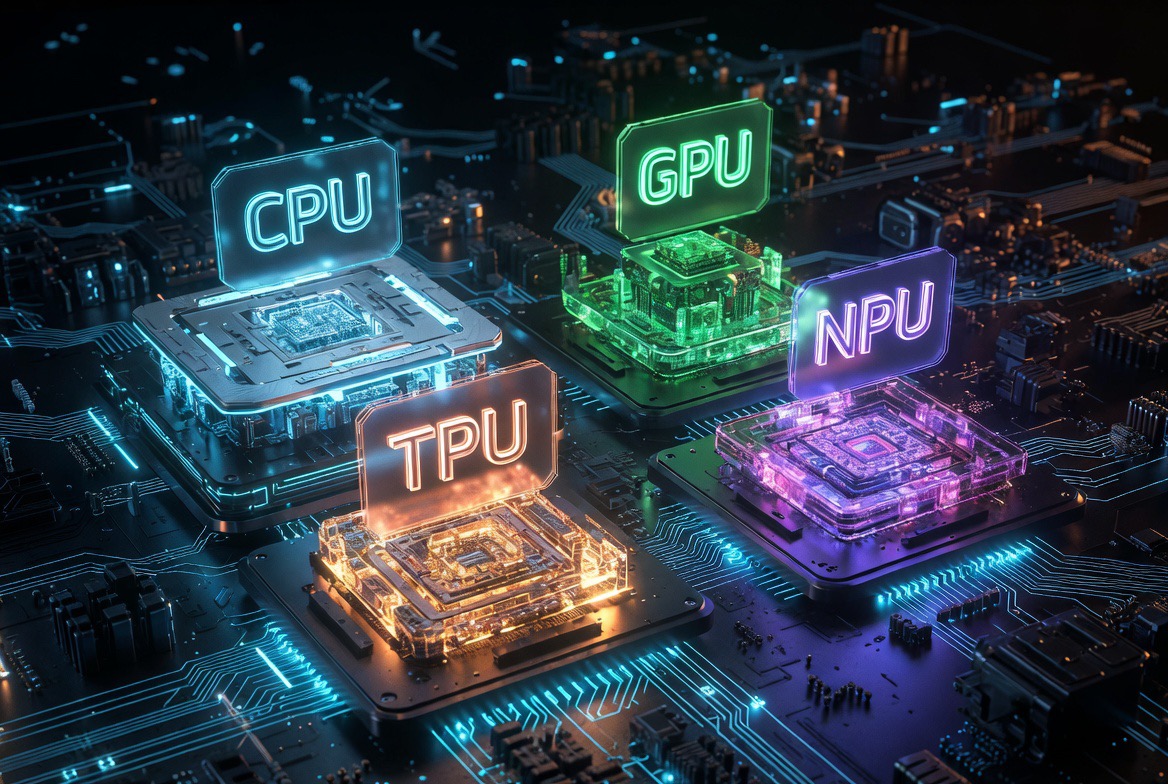

Hierzu wurden z. B. neben dem Prozessor (CPU) und einem Grafikchip (GPU) auch eine „TPU“ und auch eine „NPU“ entwickelt. Beide neuen Prozessoren sind für speziell für Ki-Anwendungen entwickelt worden.

Während TPUs auf der Serverfarmen von Googlerechner laufen, um z. B. ChatCPT zu unterstützen, werden NPUs auf Apple iPhone eingesetzt, um dort dem User schnelleren Zugriff und geringere Verzögerungen bei der Nutzung von KI-Anwendungen zu bieten.

Hier ist ein aktueller Vergleich der AI-Hardware-Entwicklungen (Stand April 2026), mit Fokus auf CPU, GPU, TPU und NPU sowie weiteren relevanten Playern wie ASICs.

Kurzer Überblick: Warum die Hardware für die KI so wichtig ist

AI-Modelle (besonders große Sprachmodelle und multimodale Systeme) brauchen enorme Rechenleistung. Die Entwicklung geht also eher weg von universellen Prozessoren (die langsamer sind) hin zu hochspezialisierten Chips:

- Training (Modell lernen) → hohe Parallelität und Speicherbandbreite

- Inference (Modell nutzen) → Effizienz, niedriger Stromverbrauch und Latenz

Markttrends 2026:

- GPUs (vor allem NVIDIA) dominieren immer noch mit ~75–87 % Marktanteil bei AI-Beschleunigern, aber der Anteil von Custom-ASICS (TPU, Trainium etc.) wächst stark.

- Inference wandert zunehmend zu effizienteren ASICs und Edge-NPUs (On-Device AI in Handys, Laptops, Autos).

- Energieeffizienz wird zum entscheidenden Faktor (Stromkosten und Kühlung in Rechenzentren explodieren).

- Neue Architekturen: Chiplets, HBM3E-Speicher, 3nm/2nm-Prozesse, Wafer-Scale-Chips (z. B. Cerebras).

Wichtige Entwicklungen 2025–2026

- NVIDIA: Blackwell-Serie (B200/B300) mit riesigem HBM3E-Speicher (bis 288 GB). Nächste Generation Rubin (2026) soll nochmal stark zulegen (bis 50 PFLOPS in manchen Metriken). Bleibt der Standard für Training dank CUDA-Ökosystem.

- Google TPU: Mit Ironwood (v7) stark auf Inference fokussiert – höhere Dichte, bessere Effizienz und Skalierbarkeit (bis Tausende Chips in Pods). Oft günstiger und energieeffizienter als GPUs für Google-spezifische Workloads.

- AMD: MI350/MI355X-Serie als ernsthafter Konkurrent zu Blackwell (288 GB HBM3E, stark bei Inference). Gewinnt Marktanteile bei Hyperscalern.

- Weitere ASICs: AWS Trainium3 (bis 4× Effizienz), Microsoft Maia, Meta eigene Chips. Diese Custom-Chips senken Kosten und Stromverbrauch bei großen Playern.

- Edge / NPU: Explosion bei Laptops und Smartphones. Qualcomm führt bei TOPS und Batterielaufzeit, Apple mit unified Memory stark bei On-Device-LLMs, Intel und AMD holen auf.

- Zukunftstrends: Heterogene Systeme (CPU + GPU + NPU zusammen), Chiplet-Designs, neuromorphe Chips (hirnähnlich), In-Memory-Computing und Wafer-Scale-Ansätze für extreme Skalierung.

Zusammenfassung – Wann wird welcher Chip eingesetzt?

- Großes Training → GPU (NVIDIA) oder TPU (bei Google Cloud)

- Massen-Inference in der Cloud → TPU / Custom-ASIC (kostengünstiger & effizienter)

- On-Device / Mobile AI → NPU (niedriger Verbrauch, Datenschutz)

Mehr dazu: https://blog.qnap.com/de/cpu-gpu-npu-tpu-was-sind-sie/